Üblicherweise sind die Arbeitsbereiche von Menschen und Robotern in der automatisierten Sachgüterproduktion heute noch streng getrennt. Handelt es sich um schwere Industrieroboter, wird das auch in Zukunft so bleiben. Nähern sich Personen so einem tonnenschweren Roboterarm, werden diese von Sensoren (z. B. Laserscanner, Lichtschranken etc.) erfasst und die Steuerung stoppt die Bewegung. In immer mehr Produktionsprozessen werden Roboter aber auch zur Unterstützung von Menschen eingesetzt. Für so einen gemeinsamen Arbeitsplatz braucht es eine sichere, produktive und unterstützende Abstimmung zwischen Mensch und Roboter. Hier muss der Roboter besondere Aufmerksamkeit auf seine Umgebung legen. Im EU-geförderten Projekt CapSize arbeiten Fachleute von JOANNEUM RESEARCH ROBOTICS, der Alpen-Adria-Universität Klagenfurt und der Fachhochschule Kärnten gemeinsam an neuen Sensortechnologien für die Umgebungswahrnehmung des Roboters. Die entwickelte Technologie lässt sich sowohl zur intuitiven Steuerung durch Gesten, als auch zur rücksichtsvollen Bewegungsplanung und Regelung des Roboters einsetzen.

Kombinierte Sensorik und flotte Algorithmen

Projektleiter Stephan Mühlbacher-Karrer von JOANNEUM RESEARCH ROBOTICS beschreibt die Ausgangslage so: „Das Fehlen geeigneter Sensorik verhindert bisher den sicheren Betrieb einer kollaborierenden Roboteranwendung mit hoher Geschwindigkeit. Bei aktuell verwendeten kamerabasierten Lösungen kann es z. B. durch die Bewegung des Roboters zu Verdeckungen kommen und der Roboter muss frühzeitig in einen sicheren Zustand gesetzt werden. Der wesentliche Grund dafür sind Einschränkungen der zur Verfügung stehenden Sensortechnologie zur Umgebungswahrnehmung in Bezug auf Geschwindigkeit, Reichweite, Integrierbarkeit etc…” In dem Kompetenzcluster in Kärnten werden neuartige Näherungssensoren mit bewährten Technologien wie Time-of-Flight (ToF) und Radarsensoren, wie sie auch in Fahrerassistenzsystemen von Fahrzeugen zum Einsatz kommen, kombiniert. Zudem müssen reaktionsschnelle und zuverlässige Algorithmen für die Steuerung einer für den Menschen sicheren Bewegung des Roboterarms entwickelt werden.

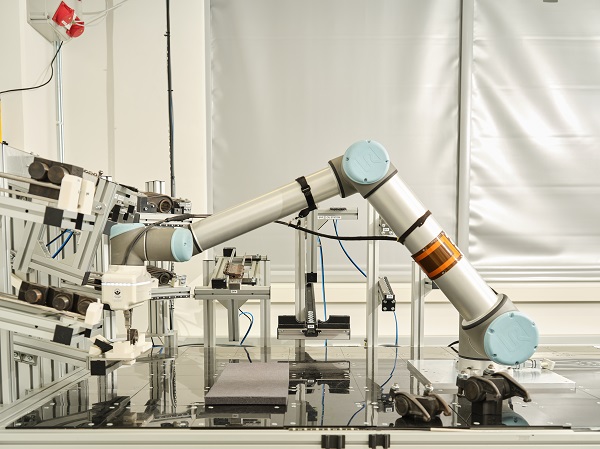

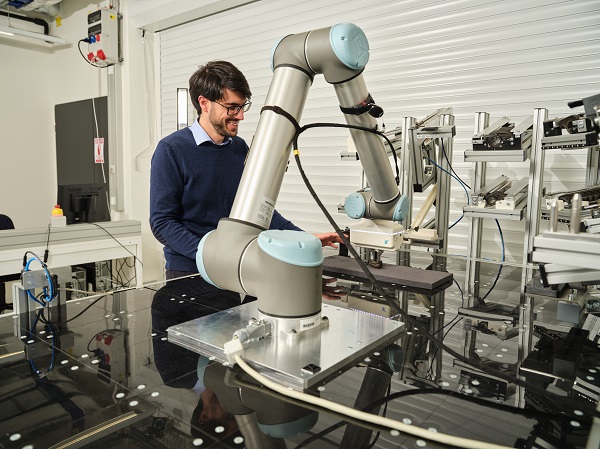

Prototyp im Labortest

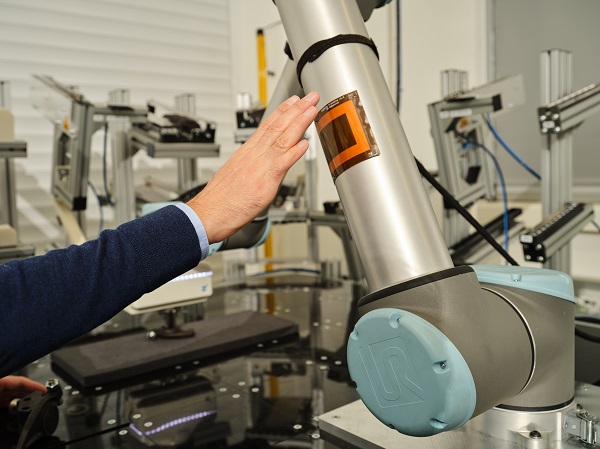

Ziel des Projekts ist letztlich, die Technologien industrierelevant zu entwickeln. So wurden gleich zu Beginn ein Tiroler Industrie-Partner für die Anwendung und ein Kärntner Technologie-Partner für den Bau eines exemplarischen Mensch-Roboter-Arbeitsplatzes an Bord geholt. Inzwischen ist ein Labor-Prototyp fertig: In dem modularen Arbeitsplatz wurde rund um einen Cobot eine Fülle von Sensoren eingebaut. Verschiedene Sensortypen ermöglichen einerseits die Gestensteuerung für den Roboter und erkennen andererseits, wo eine Person am Arbeitsplatz steht, ob sie sich annähert, oder zum Beispiel nur vorbeigeht. Eine besondere Herausforderung war dabei die Anordnung der Sensoren für den nötigen umfassenden Rundumblick.

Gestensteuerung und Bremsmanöver

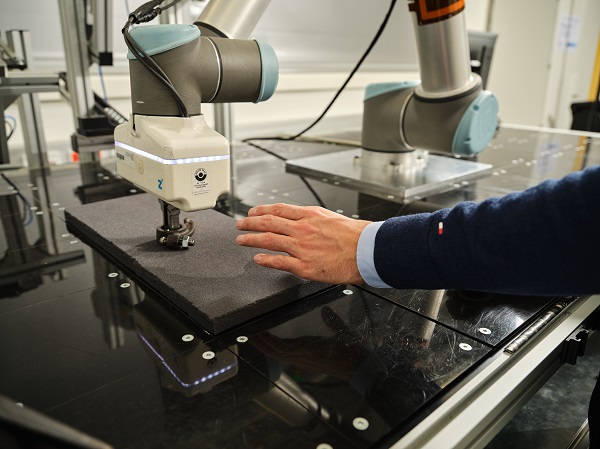

Herzstück der Versuchsanlage sind kapazitive Sensoren die in einer engen Kooperation zwischen der Alpen-Adria Universität Klagenfurt und JOANNEUM RESEARCH ROBOTICS entwickelt wurden. Diese erlauben eine feine Abstimmung und Interaktion von Mensch und Maschine: „Der kapazitive Sensor misst die Veränderung des elektrischen Feldes und kann Objekte und Personen bis zu einer Reichweite von 20 cm detektieren. Diese Sensoren können sowohl im Arbeitstisch als auch am Roboter vollständig integriert werden. So werden blinde Flecken vermieden, auch wenn Mensch und Roboter sich nahekommen und für eine Kamera der risikobehaftete Kollaborationsbereich durch den Roboterarm verdeckt wäre“, erklärt der Senior Researcher vom Institut für Robotik und Mechatronik bei JOANNEUM RESEARCH. Genauso wichtig ist in diesem Zusammenspiel die blitzschnelle und zuverlässige Sensordatenverarbeitung: Die eingehenden Daten aus den Sensoren müssen binnen Millisekunden verarbeitet und die passende Steuerung – also Bremsen, Beschleunigen, Ausweichen, Anreichen oder Stoppen – ausgelöst werden.

In einem nächsten Schritt des Projekts wird die Datenfusion der verschiedenen Sensoren (kapazitive-, Radar-, ToF-Sensoren) umgesetzt, damit der gesamte Arbeitsbereich und dessen Umgebung bis zu einer Reichweite von 5 m abgedeckt werden kann. Das Tracking, also die Positionsbestimmung von Menschen und Maschine, wird weiter verbessert und eine vollständige Ausstattung des Arbeitsplatzes angestrebt. Gerade tüfteln die Fachleute an der Gestaltung der Sensorpads, sodass sich diese passgenau um den Roboterarm schmiegen und in alle Richtungen Daten erheben und auswerten können. Im Anschluss wird der umgesetzte Montage-Use-Case des industriellen Projektpartners in der Laborumgebung evaluiert und verifiziert. Dadurch ist in weitere Folge ein Transfer der Technologie in die Wirtschaft vielversprechend. So kann Schritt für Schritt der Vision einer geteilten Arbeit von Roboterarm und Menschenhand näher gerückt werden.